资源简介

采用BP神经网络对150组股票交易数据进行拟合,拟合精度较好。

代码片段和文件信息

clear all

clc

clf

%采用三层BP网络结构

%输入层神经元数为5,隐含层神经元数为3,输出层神经元数为1

%最大迭代次数

maxcishu=5000;

%e为计算输出和样本实际输出差

%在内存中开辟maxcishu个存储空间

e=zeros(maxcishu1);

% 输入数据维度5,输入节点数5

% maxp当日最高价序列

% minp当日最低价序列

% sp当日开盘价

% ep当日收盘价

% tnum当日成交量

% 调用数据

%shuju=xlsread(‘dm.xlsx‘ ‘B1:K151‘);

shuju=importdata(‘BP_ZXF.xlsx‘);

sp=shuju.data(:1)‘;

maxp=shuju.data(:2)‘;

minp=shuju.data(:3)‘;

tnum=shuju.data(:10)‘;

ep=shuju.data(:4)‘;

%将数据集按照2:1分为训练样本集,和测试样本集

jishu=length(ep);

jishu=ceil(jishu/3*2) ;

%测试样本集是2/3处到最后一个

spt=sp(jishu+1:end);

maxpt=maxp(jishu+1:end);

minpt=minp(jishu+1:end);

tnumt=tnum(jishu+1:end);

ept=ep(jishu+1:end);

%训练样本集

sp=sp(1:jishu);

maxp=maxp(1:jishu);

minp=minp(1:jishu);

tnum=tnum(1:jishu);

ep=ep(1:jishu);

%记录下每组的最大值最小值,为训练样本集的归一化准备

maxp_max=max(maxp);

maxp_min=min(maxp);

minp_max=max(minp);

minp_min=min(minp);

ep_max=max(ep);

ep_min=min(ep);

sp_max=max(sp);

sp_min=min(sp);

tnum_max=max(tnum);

tnum_min=min(tnum);

% 目标数据为次日的收盘价,相当于把当日收盘价时间序列向前挪动一个单位

goalp=ep(2:jishu);

%数据归一化将所有数据归一化到(0 1)

guiyi=@(A)((A-min(A))/(max(A)-min(A)));

maxp=guiyi(maxp);

minp=guiyi(minp);

sp=guiyi(sp);

ep=guiyi(ep);

tnum=guiyi(tnum);

% 后面的目标数据goalp个数是ep向前移动一位得到,所以最后一组的目标数据缺失

% 所以,要把除了目标数据goalp以外的所有数据序列删除最后一个

maxp=maxp(1:jishu-1);

minp=minp(1:jishu-1);

sp=sp(1:jishu-1);

ep=ep(1:jishu-1);

tnum=tnum(1:jishu-1);

%需要循环学习次数loopn,即训练样本的个数

loopn=length(maxp);

%为了方便表示将5个行向量放到一个5*loopn的矩阵中simp中每一列是一个样本向量

simp=[maxp;minp;sp;ep;tnum];

%隐含层节点n

%根据相关资料,隐含层节点数比输入节点数少,一般取1/2输入节点数

bn=3;

%隐含层激活函数为S型函数

jihuo=@(x)(1/(1+exp(-x)));

%bx用来存放隐含层每个节点的输出

%bxe用来保存bx经过S函数处理的值,即输出层的输入

bx=zeros(bn1);

bxe=zeros(bn1);

%权值学习率u

u=0.02;

%W1(mn)表示隐含层第m个神经元节点的第n个输入数值的权重,

%即,每一行对应一个节点

%所以输入层到隐含层的权值W1构成一个bn*5的矩阵,初值随机生成

W1=rand(bn5);

%W2(m)表示输出节点第m个输入的初始权值,采用随机生成

W2=rand(1bn);

%loopn个训练样本,对应loopn个输出

out=zeros(loopn1);

for k=1:1:maxcishu

%训练开始i表示为本次输入的是第i个样本向量

for i=1:1:loopn

%求中层每个节点bx(n)的输出,系数对应的是W1的第n行

for j=1:1:bn

bx(j)=W1(j:)*simp(:i);

bxe(j)=jihuo(bx(j));

end

%求输出

out(i)=W2*bxe;

%误差反向传播过程

%计算输出节点的输入权值修正量结果放在行向量AW2中

%输出神经元激活函数 f(x)=x

%为了书写方便,将deta用A代替

AW2=zeros(1bn);

AW2=u*(out(i)-goalp(i))*bxe‘;

%计算隐含层节点的输入权值修正量结果放在行向量AW1中需要对隐含层节点逐个处理

AW1=zeros(bn5);

for j=1:1:bn

AW1(j:)=u* (out(i)-goalp(i))*W2(j)*bxe(j)*(1-bxe(j))*simp(:i)‘;

end

W1=W1-AW1;

W2=W2-AW2;

end

%计算样本偏差

e(k)=sum((out-goalp‘).^2)/2/loopn;

%误差设定

if e(k)<=0.01

disp(‘迭代次数‘)

disp(k)

disp(‘训练样本集误差‘)

disp(e(k))

break

end

end

%显示训练好的权值

W1

W2

%绘制误差收敛曲线,直观展示收敛过程

figure(1)

hold on

e=e(1:k);

plot(e)

title(‘训练样本集误差曲线‘)

% 计算输出和实际输出对比图

figure(2)

plot(out‘rp‘)

hold on

plot(goalp‘bo‘)

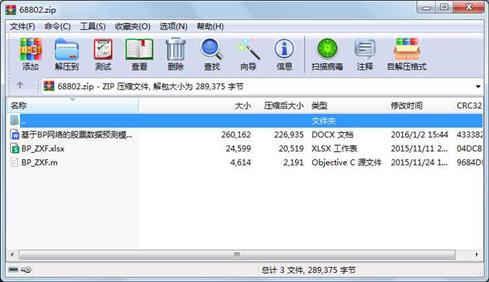

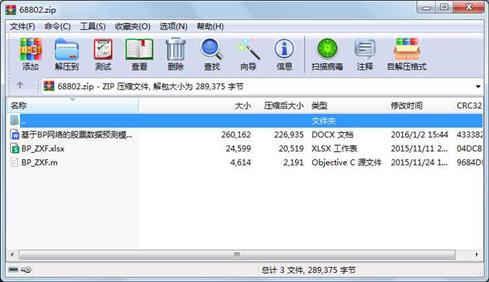

属性 大小 日期 时间 名称

----------- --------- ---------- ----- ----

文件 4614 2015-11-24 19:19 BP_ZXF.m

文件 24599 2015-11-11 23:24 BP_ZXF.xlsx

文件 260162 2016-01-02 15:44 基于BP网络的股票数据预测模型.docx

相关资源

- 连续hopfield神经网络解决TSP问题

- 改进的BP神经网络算法

- 基于bp神经网络的表情识别

- 神经网络仿真工具源代码

- 使用卷积神经网络在e + e-对撞机上改

- 用labview编写的一个神经网络Vi图

- 基于改进的SOM神经网络在产品配置中

- 深度学习卷积神经网络可检测和分类

- 标量场理论的回归和生成神经网络

- 基于ARIMA、BP神经网络与GM的组合模型

- 车辆自适应神经网络编队控制

- 基于RBF神经网络在线辨识的永磁同步

- 基于BP人工神经网络的SmFeN永磁材料工

- 融合粗糙集和人工神经网络的产品敏

- 基于粗糙集神经网络的数据挖掘在门

- Google OCR API源代码和神经网络识别OC

- 信息融合、神经网络-模糊推理理论及

- 基于双隐含层BP神经网络的预测

- SOM神经网络 PPT

- 小波神经网络预测模型代码

- 基于PSO优化BP神经网络的水质预测研究

- 基于神经网络的时间序列预测方法

- BP神经网络算法逼近一个正弦函数

- Hopfield神经网络解决 TSP问题

- 基于神经网络的数字水印

- 基于概率神经网络的图匹配算法研究

- 基于神经网络的身份证号码识别算法

- 机器学习方法R实现-用决策树、神经网

- 基于神经网络及Logistic回归的混合信用

- 台湾大学李宏毅——超详细GAN对抗神

川公网安备 51152502000135号

川公网安备 51152502000135号

评论

共有 条评论